基于FacebookPresto+Cassandra的敏捷式大数据

文件夹

“”一文,对Cassandra+Presto

结合实现大数据即席分析进行了介绍。

Presto是为满足交互式即席查询需求而优化的分布式SQL查询引擎。它支持标准ANSI SQL,包含复杂查询。聚合,连接和窗体函数。

Cassandra曾经缺少交互式即席查询功能。甚至在CQL中不支持聚合函数。由于这个原因,Cassandra在作为数据库使用时常常被混淆。分析Cassandra中的数据有下边两个框架:

1) Hadoop MapReduce

2) Spark andShark

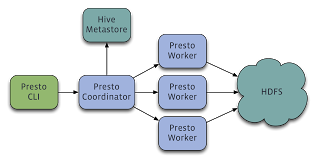

Hadoop MapReduce用于即席查询绝对够慢的。Spark的RDD模型是非常快的,可是执行查询须要多次练习。Presto是能够全然独立的执行Cassandra数据的SQL引擎。Presto的架构例如以下:

从上图中能够看出Presto的运行模型全然不同于Hive/MapReduce。Hive在运行一个MapReduce任务到另外一个时,须要将查询转换到多个阶段。

每个任务须要从磁盘读取数据并将中间的输出写入磁盘。相反,Presto引擎不要使用MapReduce。它採用了自己定义查询和运行引擎设计,支持SQL。另外,改进了调度,全部的处理是在内存中进行。并在整个阶段之间,通过网络。採用流水线处理,从而避免了不必要的I/ O和相关的延迟开销。流水线运行模型每个阶段仅仅运行一次,流数据从一个阶段到下一个阶段,没有中间停顿,这显著降低了各种查询的端至端时间延迟。

Apache Cassandra 是一套开源分布式 KeyValue 存储系统。Cassandra 不是一个数据库,它是一个混合型的非关系的数据库。

它以Amazon专有的全然分布式的Dynamo 为基础,结合了Google BigTable 基于列族(Column Family)的数据模型。

1) 分布式;

2) 高扩展性;

3) 多数据中心;

4) 分布式写操作;

5) 一致性哈希

6) GoSSIP协议简化集群管理

7) 实时更新

8) 高效的数据压缩

Cassandra最突出的特点是写性能优异,支持高并发、实时更新。

Presto是Facebook最新研发的数据查询引擎,可对250PB以上的数据进行高速地交互式分析。据称该引擎的性能是 Hive 的 10 倍以上。Presto 是一个分布式系统,执行在集群环境中,完整的安装包含一个协调器 (coordinator) 和多个 workers。查询通过比如 Presto CLI 的client提交到协调器。协调器负责解析、分析和安排查询到不同的 worker 上执行。

此外。Presto 须要一个数据源来执行查询。当前 Presto 包括支持Cassandra、Hive 的插件。

1) 分布式。

2) 内存计算;

3) ANSI-SQL语法支持;

4) JDBC 驱动

5) 用于从已有数据源中读取数据的“连接器”集合。连接器包含:HDFS、Hive和Cassandra

注:在连接Cassandra数据源时。不须要安装Hive,也不须要HDFS。

| IP | HOSTNAME | 部署模块 |

| 192.168.0.40 | NODE1 | Cassandra Presto |

| 192.168.0.41 | NODE2 | Cassandra Presto |

| 192.168.0.42 | NODE3 | Cassandra Presto |

| 192.168.0.43 | NODE4 | Cassandra Presto |

| 192.168.0.44 | NODE5:Cassandra seed Presto Coordinator | Cassandra Presto |

| 192.168.0.45 | NODE6 | Cassandra Presto |

| 192.168.0.46 | NODE7 | Cassandra Presto |

| 192.168.0.47 | NODE8 | Cassandra Presto |

使用Hbase用户

| [root@master ~]# useradd hbase [root@master ~]# passwd hbase Changing password for user hbase. New password: BAD PASSWORD: it is based on a dictionary word BAD PASSWORD: is too simple Retype new password: passwd: all authentication tokens updated successfully. |

以上命令须在8台机器上分别运行

| 程序名称 | 说明 |

| apache-cassandra-2.0.10.tar.gz | Cassandra安装程序 |

| presto-server-0.75.tar.gz | Presto安装程序 |

第一步:改动hosts文件

| [root@master java]# vi /etc/hosts |

hosts文件里加入。并在其他节点依次复制下面配置:

| 192.168.0.40 node1 192.168.0.41 node2 192.168.0.42 node3 192.168.0.43 node4 192.168.0.44 node5 192.168.0.45 node6 192.168.0.46 node7 192.168.0.47 node8 |

互信

分别在8台主机上运行下面命令:

| [hadoop@master ~]$ ssh-keygen -t rsa -P "" Generating public/private rsa key pair. Enter file in which to save the key (/home/hbase/.ssh/id_rsa): Created directory '/home/ hbase /.ssh'. Your identification has been saved in /home/hbase/.ssh/id_rsa. Your public key has been saved in /home/hbase/.ssh/id_rsa.pub. The key fingerprint is: 93:fd:d4:b7:27:aa:10:25:66:a7:c8:b6:e6:31:4c:18 hbase @master The key's randomart image is: +--[ RSA 2048]----+ | | | | | E + o | | + + B . | | . = S . . . .| | + . o o ..| | * . . ...| | o o . . ..| | . ... | +-----------------+ [hbase@master .ssh]$ cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys [hbase@master .ssh]$ chmod 600 ~/.ssh/authorized_keys |

在node5主机运行例如以下命令,并将完整的authorized_keys分发到各台主机:

| [hbase@master .ssh]$ scp authorized_keys hbase@slave1:~/.ssh/ hbase@slave1's password: authorized_keys 100% 1990 1.9KB/s 00:00 其他节点依次相同处理。 |

測试node5节点到各个slave节点的ssh可用性:

| [hbase@master .ssh]$ ssh slave1 Last login: Wed Aug 7 22:24:19 2013 from 192.168.0.25 [hbase @slave1 ~]$ exit logout Connection to slave1 closed. 其他节点依次类推。 |

已经安装jdk1.7_51

| [hbase@ node5 ~]$ tar -xzf apache-cassandra-2.0.10.tar.gz |

| [hbase@ node5 ~]$ cd apache-cassandra-2.0.10/conf/ [hadoop@slave1 conf]$ vi cassandra.yaml |

cassandra.yaml内容

| … cluster_name: 'sunrise Cluster' - seeds: "192.168.0.44" --> - seeds: "node IP address" data_file_directories: - /home/hbase/cassandra/data commitlog_directory: /home/hbase/cassandra/commitlog saved_caches_directory: /home/hbase/cassandra/saved_caches listen_address: 192.168.0.44 native_transport_port: 9042 rpc_address: 192.168.0.44 rpc_port: 9160 … |

cluster_name:这个配置项是用来标识集群名称的。

data_file_directories:这个配置项是用来配置Cassandra数据文件夹的。

commitlog_directory: 这个配置项是用来配置Cassandra提交日志文件夹的。

saved_caches_directory:这个配置项是用来配置Cassandra缓存文件夹的。

listen_address:这个配置项定义了集群中其它节点的连接方式。

所以多节点的集群必须将这个改成他实际的网卡地址。

listen_address:这个配置项定义了集群中其它节点的连接方式。

所以多节点的集群必须将这个改成他实际的网卡地址。

rpc_address:这个配置项定义了这个节点在哪里监听client。所以能够跟node的IP地址一样,或者设置为0.0.0.0,假设我们想在全部的可用网卡接口上监听的话。

Seeds:seeds作为连接点。当一个新的节点增加到集群中的时候,他联系seeds得到其它节点的一些基础信息。

所以在多节点中,作为种子的节点必须是全部的节点都能够通过路由连接到的。注:在多节点的集群中,最好拥有多个seeds。

多个节点作为seeds能够通过例如以下方式定义。

启动:

| Node1 – node8 |

| [hbase@node5 cassandra |

查看状态

| Node5 |

| [hbase@node5 apache-cassandra-2.0.10]$ ./bin/nodetool -host 192.168.0.44 -p 7199 status UN 192.168.0.45 215.5 KB 256 12.8% 55a15b62-b3a9-4fa3-ad76-284ce8132ff5 rack1 UN 192.168.0.44 204.95 KB 256 11.6% 4b736f9e-d904-4d69-80f3-66492a1a0344 rack1 UN 192.168.0.47 207.25 KB 256 13.7% 0744e75b-dc9e-4be3-9cd4-9a803f141abb rack1 UN 192.168.0.46 202.26 KB 256 12.4% e2087e1a-6c06-4b24-9355-f27890b0e9c6 rack1 UN 192.168.0.41 180.9 KB 256 13.0% 7aac038a-8bf7-45d7-b385-a2c434ed96ff rack1 UN 192.168.0.40 189.13 KB 256 12.7% de8cb5e2-fce3-4735-bfc0-c21f51b1e7d8 rack1 UN 192.168.0.43 184.23 KB 256 12.3% 3ef670c3-d61e-406f-b853-20a06747cd21 rack1 UN 192.168.0.42 184.83 KB 256 11.5% 3055f3e2-7003-440c-a198-e7ff7c862ec0 rack1 |

创建keyspace、user表、插入数据

| Node5 |

| [hbase@node5 apache-cassandra-2.0.10]$ ./bin/cqlsh -u cassandra -p cassandra 192.168.0.44 9160 [cqlsh 4.1.1 | Cassandra 2.0.10 | CQL spec 3.1.1 | Thrift protocol 19.39.0] Use HELP for help. cqlsh> CREATE KEYSPACE munion_db WITH REPLICATION = { 'class' : 'SimpleStrategy', 'replication_factor' : 2 }; cqlsh>use munion_db; cqlsh>create table users(user_id int primary key, fname varchar,lname varchar); cqlsh> INSERT INTO users (user_id, fname, lname) VALUES (1744, 'john', 'smith'); cqlsh> INSERT INTO users (user_id, fname, lname) VALUES (1745, 'john', 'doe'); cqlsh> INSERT INTO users (user_id, fname, lname) VALUES (1746, 'john', 'smith'); cqlsh> INSERT INTO users (user_id, fname, lname) VALUES (1747, '測试', '測试'); cqlsh>select * from users; user_id | fname | lname ---------+-------+--------- 1744 | john | smith 1745 | john | doe 1746 | john | smith 1747 | 測试| 測试 |

| [hbase@node5~]$ tar -xzf presto-server-0.75.tar.gz [hbase@node5~]$ cd presto-server-0.75 |

配置文件内容:

| node.environment=pretest node.id=node5 node.data-dir=/home/hbase/presto-server-0.57/presto/data |

配置文件内容:

| node.environment=pretest node.id=node5 node.data-dir=/home/hbase/presto-server-0.57/presto/data [hbase@node5 etc]$ cat jvm.config -server -Xmx6G -XX:+UseConcMarkSweepGC -XX:+ExplicitGCInvokesConcurrent -XX:+CMSClassUnloadingEnabled -XX:+AggressiveOpts -XX:+HeapDumpOnOutOfMemoryError -XX:OnOutOfMemoryError=kill -9 %p -XX:PermSize=150M -XX:MaxPermSize=150M -XX:ReservedCodeCacheSize=150M -Xbootclasspath/p:/home/hbase/presto-server-0.57/lib/floatingdecimal-0.1.jar -Djava.library.path=/home/hbase/hadoop/lib/native/Linux-amd64-64> |

配置文件内容

| coordinator=true #node5,其它节点设为false #node-scheduler.include-coordinator=false http-server.http.port=40000 task.max-memory=1GB discovery-server.enabled=true discovery.uri=http://node5:40000 |

| com.facebook.presto=INFO |

编辑Catalog Properties文件,加入例如以下内容

| connector.name=cassandra cassandra.contact-points=node1,node2,node3,node4,node5,node6,node7,node8 |

启动Presto,命令例如以下:

| [hbase@node5 ~]$ cd /home/hbase/presto-server-0.75 [hbase@node5 ~]$./bin/launcher start [hbase@node5 ~]$./bin/launcher start [hbase@node5~]$./presto --server 192.168.0.44:40000 –catalog cassandra --schema munion_db presto:munion_db>select * from users; presto:munion_db> user_id | fname | lname ---------+-------+--------- 1744 | john | smith 1745 | john | doe 1746 | john | smith 1747 | 測试| 測试 |

支持

Create tabe/view:仅仅支持Createtabe/view as select …

支持连接:Inner join、left join、right join

聚合函数:支持count、max、min等

支持insert操作。

支持copy导入数据;

支持kettle导入数据。

支持

支持程序使用JDBC接口;

Javaclient调用JDBC出错;

报表工具连接JDBC源有待验证;

未做。

相对于Hadoop/Hive/HBase/Spark,Cassandra+Presto不失为一种大数据的敏捷方案。

Kettle提供了Cassandra的ETL组件。CQLSH提供了类似于ER的数据模型,Presto提供了跨数据源的交叉查询能力,并提供了丰富的SQL功能。

此外,JDBC驱动提供了对程序、client工具及报表工具的连接能力。

由于时间和人力资源限制,不得不停止Cassandra+Presto的測试验证工作,进一步的性

能測试也没能去測。虽然如此,该方案仍然可觉得是可行的。或许,在将来某个时间,Cassandra+Presto将被又一次提及。并被採用。

Presto升级非常快,如今已经到了0.78版本号,在0.77中已经实现了分布式Hash功能。虽然还处于试验阶段。相对与Hadoop/HBase/Hive/Spark来说。採用Flume+Cassandra+Presto+SpagoBI无疑是一个敏捷的大数据解决方式。

希望能对准备使用大数据的同道们有所帮助!